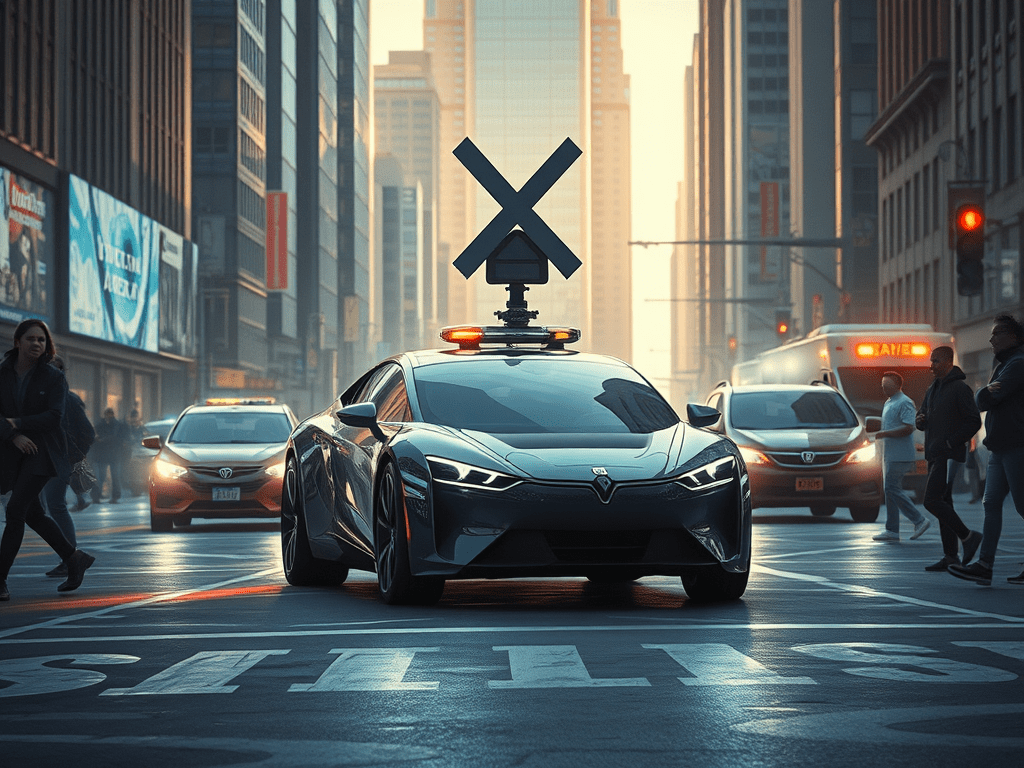

La llegada de los vehículos autónomos promete reducir drásticamente los accidentes de tráfico, mejorar la eficiencia del transporte y liberar tiempo para millones de personas. Sin embargo, también trae consigo una serie de dilemas éticos profundamente humanos que ahora deben ser resueltos por algoritmos. ¿Qué debe hacer un coche autónomo ante un accidente inevitable? ¿A quién debe proteger?

Este artículo explora el complejo terreno de la ética en la automoción autónoma, donde la inteligencia artificial se ve obligada a tomar decisiones de vida o muerte en fracciones de segundo.

Cuando conducir implica juzgar

En una fracción de segundo, un conductor humano puede enfrentarse a decisiones trágicas: girar el volante y atropellar a un peatón para evitar a otro, frenar sin saber si eso evitará el impacto, o continuar con la esperanza de que alguien reaccione. Estas situaciones, aunque excepcionales, forman parte de la realidad vial.

Ahora, estas mismas decisiones deben ser programadas en los vehículos autónomos. El dilema no es solo técnico: es moral. ¿Debe un coche priorizar a su pasajero o al peatón? ¿Y si hay niños involucrados? ¿O ancianos? ¿Debe contar cuántas vidas salvaría cada opción?

El dilema del tranvía… sobre ruedas

Estos conflictos recuerdan al clásico “dilema del tranvía”: un tren sin frenos puede desviarse y matar a una persona para salvar a cinco. Trasladado a los coches autónomos, este dilema se vuelve aún más inquietante, porque implica programar el resultado por adelantado.

Estudios como el Moral Machine del MIT han mostrado que las preferencias morales varían por cultura, edad o contexto. Algunas sociedades priorizan la vida del pasajero, otras del peatón; unas valoran más a los jóvenes, otras a quienes respetan las normas. No existe una única ética universal.

¿Puede entonces una IA tomar decisiones éticas sin consenso social?

¿Quién decide qué es lo correcto?

El verdadero dilema está en la delegación de la moralidad. Si un fabricante programa que su coche proteja siempre a su cliente, ¿está sacrificando a otros en nombre del negocio? Si elige salvar más vidas, ¿aceptarán los usuarios viajar en un coche que podría sacrificarlos?

Además, ¿quién asume la responsabilidad legal en caso de accidente? ¿El programador, el fabricante, el propietario… o el algoritmo?

Esta falta de claridad legal y ética es uno de los grandes obstáculos para la implementación masiva de vehículos totalmente autónomos.

Diseñar la ética: transparencia, regulación y participación

Una de las respuestas más sólidas a estos dilemas es el diseño ético desde el principio. Los vehículos deben contar con sistemas de toma de decisiones que sean transparentes, auditables y sujetos a regulación. Además, los criterios éticos deben ser definidos no solo por ingenieros, sino también por filósofos, legisladores y la sociedad en su conjunto.

Algunas propuestas plantean incluso la posibilidad de que el usuario elija su “perfil ético” al comprar el coche. Aunque atractiva en teoría, esta opción podría abrir la puerta a decisiones morales individualizadas con consecuencias imprevisibles.

Conclusión: algoritmos con conciencia

La automatización de la conducción promete salvar millones de vidas. Pero si no resolvemos de forma colectiva y reflexiva los dilemas éticos que plantea, podríamos terminar delegando las decisiones más humanas a sistemas que carecen de empatía, contexto o justicia.

El coche autónomo no solo debe saber conducir: debe saber cómo y por qué tomar ciertas decisiones. La ética de la automoción no es un complemento: es el motor moral de esta revolución tecnológica.

¿Estamos preparados para que un algoritmo decida por nosotros… incluso en los momentos más críticos?

Deja un comentario